El invierno pasado, Jonathan Ross, cofundador y director ejecutivo de Groq, se reunió con Jensen Huang, director ejecutivo de Nvidia, para proponer la colaboración tecnológica entre ambas compañías. Ahora describe esta sinergia con una analogía logística: dejar de construir centros de datos de IA como si cada carga de trabajo requiriera el mismo hardware. El entrenamiento es como el transporte a granel; la inferencia, como la entrega de última milla. Las GPU pueden hacer ambas cosas, pero usar un camión de dieciocho ruedas, incluso cuando solo se necesita una furgoneta, puede ser mucho más lento. Así pues: las GPU de propósito general de Nvidia son los camiones grandes. Los chips especializados de Groq —las LPU, o unidades de procesamiento del lenguaje, diseñadas para ejecutar modelos rápidamente— son las furgonetas más pequeñas. «Si estuvieras construyendo una red logística para todo Estados Unidos y te dijera que tus dos opciones son camiones de dieciocho ruedas o solo furgonetas de reparto, ¿cuál elegirías?», dijo Ross. «La mejor respuesta es ambas».

Ross no solo exponía su visión del mundo. Quería el permiso de Nvidia para comprar unos 100.000 chips Blackwell, cuyo valor probablemente ascendería a miles de millones. Huang lo interrogó sobre los detalles técnicos y, acto seguido, la reunión concluyó.

Cuando Huang volvió a llamar tres días después, Ross esperaba hablar sobre su pedido de GPU. En cambio, el director ejecutivo de Nvidia fue directo al grano. «Probablemente deberíamos actuar con mucha rapidez», recordó Ross que le dijo.

Tres semanas después, Nvidia anunció en Nochebuena un acuerdo de 20.000 millones de dólares para licenciar el producto de Groq y contratar a la mayor parte de su plantilla. En términos de Silicon Valley, se podría describir como una fusión sin papeleo: llevarse el equipo, asegurar la tecnología y obtener el beneficio estratégico sin heredar todos los cabos sueltos de la empresa ni enfrentarse a problemas antimonopolio. (La empresa independiente que Groq sigue siendo, un proveedor de servicios en la nube LPU, aún existe y está creciendo, según declaró Ross —ahora arquitecto jefe de software de Nvidia— a Forbes ; antiguos empleados afirmaron el mes pasado que se espera que la empresa se venda, pero aún no lo ha hecho).

En aquel momento, no tenía sentido para todos, porque no estaba claro qué pretendía Nvidia con Groq más allá de una costosa campaña de prensa para promocionar la inferencia. Incluso la propia explicación de Huang generó desconcierto. «Les costaba mucho llegar al público general de las fábricas de IA», declaró en una conferencia a principios de este año. «Pero con nosotros, ya no tienen que hacerlo».

Pero tres meses después, Nvidia dejó claras sus intenciones al dedicarle un amplio espacio en su conferencia anual de desarrolladores a Groq. La empresa más pequeña no tenía que hacerse popular por sí sola; solo tenía que volverse útil dentro de la compañía de IA más conocida, que ya era una empresa consolidada.

Todos ya habían cobrado: Ross se lleva a casa unos 950 millones de dólares en efectivo (después de impuestos) según su participación estimada del 9%; cuando se consolide su compensación en acciones de Nvidia (probablemente una parte considerable de los 3.000 millones de dólares reservados para los empleados que se fueron a Nvidia), se convertirá en multimillonario. Ross declinó hacer comentarios sobre su patrimonio neto, pero valdría mucho más si el acuerdo hubiera sido una compraventa de acciones o de activos en lugar de un contrato de licencia con doble tributación y mayoritariamente en efectivo. Otros grandes beneficiarios son Social Capital, del inversor Chamath Palihapitiya, y su cofundador Doug Wightman, que poseían participaciones estimadas similares a las de Ross, y Sunny Madra, director de operaciones y presidente de Groq, a quien Ross atribuye el éxito del acuerdo. También está el gobierno estadounidense: la estructura del acuerdo implica que el gobierno estadounidense probablemente se embolsará más de 6.000 millones de dólares en ingresos fiscales, aunque Nvidia también puede beneficiarse de unas deducciones fiscales estimadas de 3.000 millones de dólares.

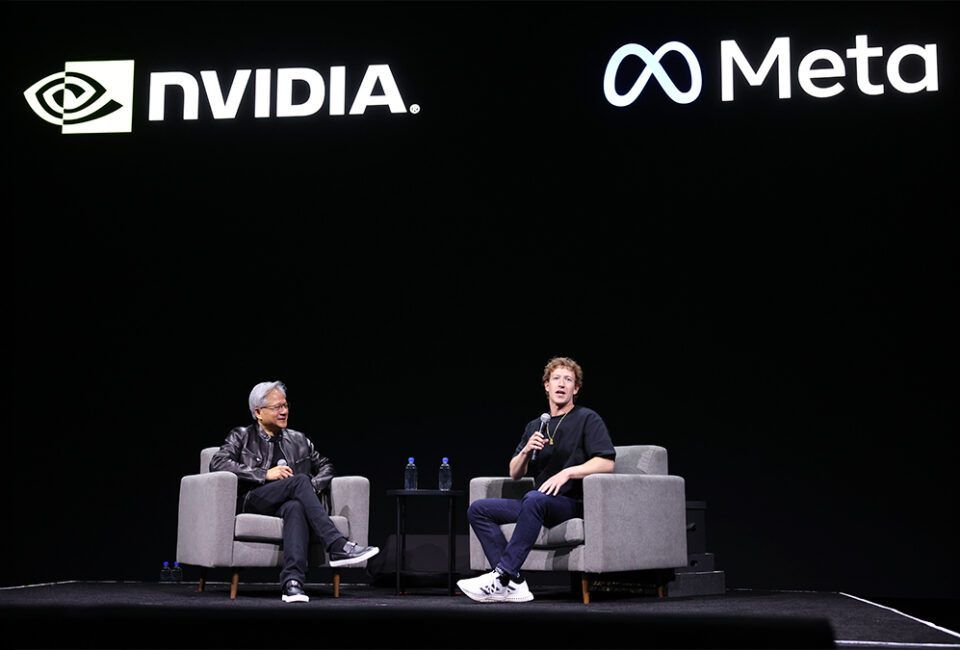

En la conferencia anual de desarrolladores de Nvidia celebrada el lunes, Huang bautizó el año 2026 como el año de la inferencia de IA: el proceso de utilizar la inteligencia artificial en lugar de entrenarla.

Luego anunció un nuevo producto que integra los chips LPU especializados de Groq —conocidos por su velocidad de inferencia excepcional— con la nueva generación de GPU Vera Rubin de Nvidia. El mensaje implícito: la era de las GPU que lo hacen todo choca con la parte del mercado que valora menos el rendimiento en entrenamiento y más el costo, la latencia y el procesamiento a gran escala. Nvidia, el principal defensor de la monocultura de las GPU, está, en efecto, avalando una idea heterodoxa: a veces se necesita algo que no sea una GPU.

Los chips están en plena producción y se prevé que comiencen a distribuirse este verano. Nvidia no quiso especificar cuántos chips Groq planea fabricar, aunque todo apunta a que serán muchos. «Puedo asegurar que es una producción a escala de Nvidia», declaró Ross. «Esto no es un proyecto piloto».

Ross comentó que ha participado en “muchas” reuniones con clientes, aunque aún no se ha anunciado ningún comprador. “No sé si puedo confirmar algún pedido ahora mismo”, dijo Dion Harris, director sénior de computación de alto rendimiento e infraestructura de IA de Nvidia. “Es pronto, pero hay mucho interés”.

Fotografía de Benjamin Fanjoy/Getty Images

En cualquier caso, el acuerdo consolida la confianza del mercado en los chips de inferencia de IA, incluso si la alianza Groq-Nvidia parece tener ventaja en la distribución, según otros líderes del sector. El nuevo producto, Nvidia Groq 3 LPX, «reconoce que las GPU por sí solas no satisfacen las necesidades del mercado de inferencia, que crece a un ritmo acelerado», escribió Sam Fok, director ejecutivo de femtoAI, fabricante de chips de inferencia de IA para computación perimetral. Fok cree que los métodos de inferencia más económicos y accesibles impulsarán una mayor demanda. «Ha validado el mercado que llevamos tiempo impulsando», afirmó Sid Sheth, cofundador y director ejecutivo de d-Matrix. «La siguiente fase del crecimiento de Nvidia vendrá de la inferencia». Cerebras, competidor de Groq, anunció acuerdos con OpenAI y Amazon en los últimos dos meses. Jim Keller, director ejecutivo de Tenstorrent, añade: «Groq abrió la puerta a la computación heterogénea… Seguro que alguien hizo los cálculos».

Lo cual está muy bien, porque el acuerdo casi no se concretó. La estrategia de Nvidia es ser la plataforma indispensable para el ecosistema, y los chips de inferencia son su última incorporación. Está pasando de ser una «buena idea» a una tecnología con el respaldo de Nvidia.

Nvidia

Groq nació en 2016 como respuesta —la inferencia ultrarrápida— a una pregunta que gran parte del mercado aún no se había planteado. «Groq estuvo a punto de fracasar varias veces», declaró Ross a Forbes en 2024. «Quizás empezamos demasiado pronto».

En 2023, siete años después de su fundación, Groq generó 3 millones de dólares en ingresos con pérdidas de 88 millones de dólares. A mediados de 2024, cuando recaudó 640 millones de dólares con una valoración de 2.800 millones de dólares, los ingresos seguían siendo «relativamente insignificantes», según Mark Edwards, director de inversiones de Alumni Ventures, que invirtió por primera vez en Groq en 2021.

Dos fuentes informaron a Forbes que, en la época del acuerdo con Nvidia, los ingresos anuales de Groq rondaban los 100 millones de dólares, muy por debajo de sus proyecciones iniciales para 2025, que ascendían a 2.000 millones de dólares, y posteriormente a 500 millones de dólares (cifra revisada). Su acuerdo más importante y su principal cliente fue el fondo soberano de Arabia Saudita. Ross afirmó que Groq estaba funcionando «bien», alcanzando «algunos objetivos» y en conversaciones con otros grandes clientes, pero declinó hacer comentarios sobre los ingresos de 2025.

En los meses previos al acuerdo con Nvidia, Ross promocionó públicamente la alianza con Arabia Saudí, afirmando que generaría enormes ingresos para la empresa. «No recaudamos 1.500 millones de dólares», declaró Ross en el podcast de 20VC hace un año. «Eso son ingresos. De hecho, representa aproximadamente el 30 % de los ingresos de OpenAI».

Sin embargo, un exempleado declaró a Forbes que la cifra principal se refería al «valor acumulado de los servicios que iban a desarrollar». Es probable que dicha cifra incluyera el coste total de la construcción del centro de datos que albergaría los chips Groq, el valor de los propios chips y el valor de la potencia informática que generarían (durante un período de tiempo indeterminado).

El acuerdo de Groq con Arabia Saudí —en concreto con Aramco Digital, una filial tecnológica de la petrolera estatal— se estructuró como un acuerdo de reparto de ingresos, según tres exempleados. Groq vendería sus chips de IA a Aramco a un precio relativamente bajo; Aramco financiaría el centro de datos para alojarlos; y ambas partes se repartirían los ingresos generados por la capacidad de procesamiento de los chips.

Y no todas las “asociaciones” parecían una transacción limpia de dinero por producto. En otra de las asociaciones de alto perfil de Groq, con la empresa de inversión inmobiliaria de centros de datos Equinix en Australia, Groq es el cliente, pagando a Equinix hasta 300 millones de dólares para que Groq aloje LPU y, a su vez, las venda a sus clientes de la nube. “Parecía más bien un intercambio de fondos, pero también un trueque de bienes”, dijo una fuente a Forbes .

No está claro cómo han continuado estos acuerdos bajo el paraguas de Nvidia, ni hasta qué punto formaron parte de las negociaciones con Nvidia. Ross afirmó que solo influyó en la medida en que la empresa independiente de Groq sigue prestando soporte a sus clientes saudíes.

La integración que Nvidia presentó el lunes utiliza el chip de tercera generación de Groq. Según Ross, su segunda generación, que se había retrasado, aún no había alcanzado su máxima producción, pero Groq optó por una nueva versión porque la integración con Nvidia habría tardado lo mismo que si hubieran empezado desde cero con una tercera versión.

A pesar de las dificultades, Ross insistió en que siempre se mostró confiado y con grandes ambiciones. «Pensé que iba a morir en Groq», recordó haber pensado. «Siempre les decía a todos que queríamos ofrecer la mitad de la inferencia mundial».

Aunque un exempleado afirmó que el objetivo de Groq siempre fue colaborar con Nvidia, Ross no estaba seguro al principio de que los chips de Groq y las GPU de Nvidia se integraran bien. «Casi no lo hacemos», comentó Ross sobre la idea que le presentó a Huang a finales del año pasado. Añadió que Madra, quien ahora es vicepresidente de Nvidia, lo convenció. Al final, resultó ser la combinación perfecta, tanto a nivel empresarial como cultural, afirmó Ross.

Ahora la apuesta pasa de la teoría del acuerdo a la realidad del producto. Aún es demasiado pronto para saber cómo se desempeñará el sistema Nvidia-Groq, denominado LPX, ya que se presenta como una integración opcional con la plataforma Vera Rubin de Nvidia y todavía no se utiliza a gran escala. En la conferencia del lunes, Huang afirmó que podría generar 300 mil millones de dólares en ingresos anuales por gigavatio y que espera que alrededor del 25 % de las cargas de trabajo de GPU se conecten con los chips Groq.

Éramos como «niños en una tienda de caramelos», dijo Ross sobre su incorporación a Nvidia. «De repente, teníamos acceso a todo».

Esta noticia se ha actualizado para aclarar que cuando Ross dijo «casi no lo hacemos» se refería a la idea inicial de integración entre GPU y LPU, previa al acuerdo.

Este artículo se ha publicado originariamente en Forbes.com