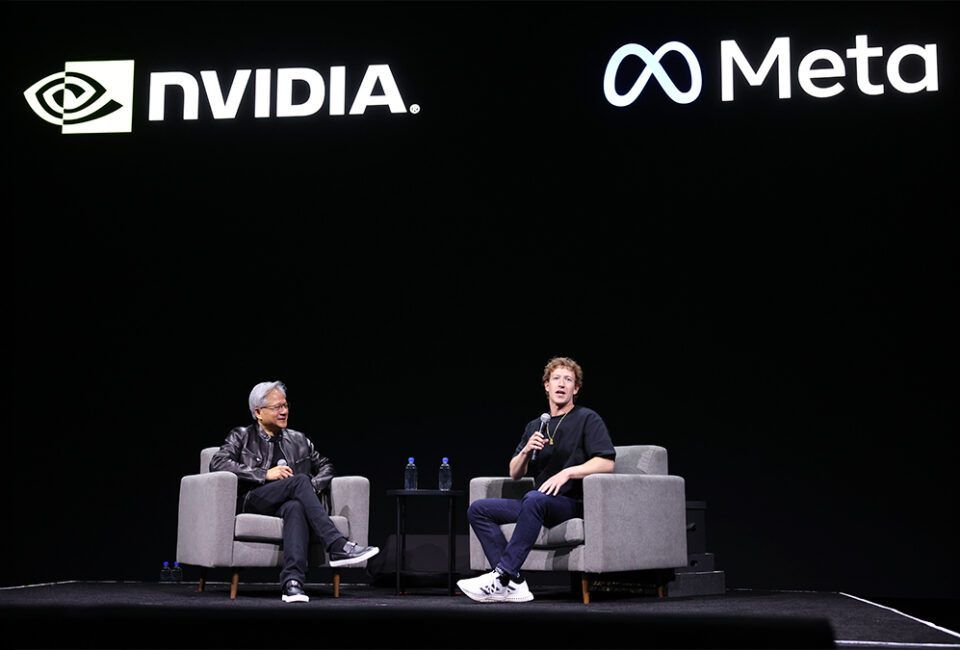

La Comisión Europea ha acusado formalmente a Meta y TikTok de incumplir la Ley de Servicios Digitales (DSA, por sus siglas en inglés). Según Bruselas, ambas compañías habrían restringido el acceso de los investigadores a datos públicos y no ofrecerían herramientas sencillas para que los usuarios denuncien contenidos ilegales en sus plataformas.

De acuerdo con las primeras conclusiones de la investigación, Facebook, Instagram y TikTok habrían establecido procedimientos complejos y poco transparentes para permitir el acceso a información pública. La Comisión sostiene que estas trabas dificultan el trabajo de los investigadores y hacen que solo puedan obtener datos incompletos o poco fiables. Esto limita su capacidad para analizar cómo se exponen los usuarios en especial los menores a contenido dañino o ilegal.

Bruselas recordó que garantizar el acceso de los investigadores a los datos de las plataformas es una obligación fundamental de transparencia prevista en la DSA. Este principio busca que exista un control público sobre el posible impacto de las redes sociales en la salud física y mental de los ciudadanos europeos.

En el caso concreto de Meta, la Comisión también señaló fallos en los sistemas de Facebook e Instagram para denunciar material ilícito, como abusos sexuales infantiles o propaganda terrorista. Según la investigación, estas redes no disponen de un mecanismo de “aviso y acción” fácil de usar y habrían incorporado “patrones oscuros”, es decir, diseños que confunden o desaniman a los usuarios a la hora de reportar infracciones.

Bruselas considera que los mecanismos de Meta para eliminar o restaurar contenido ilegal podrían ser poco eficaces. También detectó problemas en los procesos de apelación, ya que los usuarios no siempre pueden aportar pruebas o argumentos cuando quieren impugnar una decisión de moderación. Esto, según la Comisión, limita el derecho de recurso de los europeos.

Tanto Meta como TikTok tendrán ahora la oportunidad de revisar la documentación del caso y presentar sus respuestas por escrito antes de que la Comisión Europea tome una decisión definitiva. Si finalmente se confirma el incumplimiento, las plataformas podrían enfrentarse a multas de hasta el 6% de su facturación global anual o a sanciones adicionales para asegurar el cumplimiento de la ley.

Según datos del propio Ejecutivo comunitario, desde abril de 2024 Meta ha tomado más de 918 millones de decisiones de moderación de contenido que afectan a usuarios europeos. De ellas, unos 68 millones fueron recurridas y en aproximadamente el 31% de los casos (21 millones de contenidos), la compañía tuvo que restaurar el material eliminado. Estas cifras muestran el alcance de la moderación en las plataformas y la importancia de garantizar procesos transparentes y accesibles para los usuarios.